要点总结

- 人参与环AI(HITL)将AI与人工监督相结合,有效提升准确性和公平性。

- HITL遵循反馈闭环:数据标注、预测、人工纠正和模型优化。

- HITL被应用于文档处理、客户支持、医疗诊断和欺诈检测等领域。

- HITL提供更好的控制,但速度较慢且相比全自动化更难扩展。

什么是人参与环AI?

**人参与环AI(Human-in-the-Loop AI,HITL)**是一种将人工反馈或监督整合到AI系统关键阶段的人工智能方法。简而言之,就是让人在AI决策过程中持续参与审核、引导或纠正,以提升准确性、公平性和整体表现。

麦肯锡指出,企业正在加速部署AI,但随着AI日益成熟,治理和风险管理变得尤为重要。随着71%的企业现已采用生成式AI,人参与环AI(HITL)的作用比以往更加关键。

与完全让AI自主运行不同,HITL系统始终让人类参与,特别是在需要判断、伦理考虑或质量控制时。

这种方式常见于机器学习模型的训练、输出验证以及通过持续反馈完善系统。它在医疗、金融、法律服务或大规模文档处理等任何决策可能带来现实后果的行业中尤为有价值。

HITL也是实现高效人机协作的核心环节。它确保AI工具能够高效自动化,并且输出结果契合人类价值观、业务目标和合规标准。

Clanx报道,81%的企业高管认为人参与环AI对其组织十分重要。

欢迎访问我们的人参与环AI:定义、优势与2026趋势,深入了解HITL在人类智能发展中的基础作用,包括它的优势、实施策略和未来趋势。

人参与环AI是如何运作的?

HITL AI将人工参与融入AI开发与决策流程之中。这种协作让人在关键阶段对AI输出进行引导、审核与优化,以确保准确性、公平性和对复杂情境的理解。HITL不是让AI单独训练并部署,而是通过持续的反馈循环,让人类成为系统优化的重要一环。

人参与环AI(HITL)实现了人与AI之间持续、迭代的反馈闭环。人工在关键阶段引导AI,可以显著提升准确率——比自动化方法单独使用最高可提升40%(Eyt)。

标准的HITL工作流程为:

- 数据标注:人工专家为原始训练数据打标签或组织结构,帮助AI理解学习对象。例如,在文档解析系统中,人会标注发票的日期、金额和供应商等字段,教AI如何正确识别这些元素。

- 模型预测:训练结束后,AI会根据已有数据做出预测或决策,包括识别交易模式、从邮件或扫描文档中提取信息等。

- 人工反馈:人员对AI输出进行评估,指出错误、纠正失误或提出改进建议。人工输入会补充AI可能遗漏的背景信息。

- 模型优化:AI根据获得的反馈进行再训练或更新自身行为。随着迭代,这一循环不断提升系统在复杂或细分任务上的表现。

部分先进的HITL系统还采用主动学习,让AI主动识别不确定案例并请求人工介入,使人工投入集中于最需要的地方,进而提升效率。

即便AI系统已部署,在医疗、金融、法律审核等高风险领域,人工监督往往仍会保留。这样,由端到端的人机协作,企业既能利用AI的高效和可扩展性,又能在关键环节由人掌控。

人参与环AI的应用场景

HITL AI广泛应用于各类行业,在其中人工监督对于确保AI可靠性、公正性和安全性至关重要。这一方法对于需要兼顾自动化和可追溯责任的环境尤为有用。

根据Expert Beacon,集成人工反馈的图像分类准确率从91.2%提高到97.7%,充分说明了HITL对模型表现的提升。

以下为HITL带来实际价值的典型应用场景:

用HITL提升文档处理准确性

AI能够自动从非结构化文档(如发票、收据、合同或表格)中抽取结构化信息,但关键字段如总金额、供应商名称或日期通常由人工校核与修正,避免代价高昂的错误。HITL对追求数据质量、合规性或后续自动化的业务流程至关重要。

通过人机协作提升客户支持效率

许多业务采用AI客服机器人来回答常见问题,降低人工压力。但面对复杂、有情感或特殊的问题时,系统会将相应请求转由人工客服处理,实现高效与高情商兼备,确保敏感事项得到妥善响应。

用HITL确保医疗诊断精准性

医疗领域,AI工具可用于分析医学影像、标注潜在病变(如X光肿瘤)或化验异常。然而最终审核和诊断始终由医生把关,有效减少误判、保障病患安全。AI的模型帮助减少假阳性,HITL对于生死重大决策环节尤为关键。

在反欺诈系统中用人工监督强化AI检测

AI能高速扫描大规模交易,检测可疑业务。不是所有警报都属欺诈,因此人工合规员需介入,评估高风险行为、最终决策并避免误伤正常客户。金融机构通过这一分层机制兼顾速度与精准。

用人参与环AI提升自动驾驶安全性

半自动驾驶系统下,AI负责导航和环境感知,但遇到风险或不确定状况时,驾驶员可接管。这一HITL安全模型保证车辆能对突发变化快速响应。

用人机协作提升内容审核精准度

AI可批量检测用户内容中的仇恨言论、垃圾信息或虚假内容。但对于边界模糊、需语境判断的个案需人工复查,防止误删或误审,既守护平台秩序又维护用户权益。

这些实例表明,HITL让企业在提升效率的同时,更好地承担责任。人工参与关键节点使AI系统更可靠、适应性更强、更贴合现实目标。

对于涉及数据解析、合规检查和面向客户等流程的行业,这种混合模式不仅实用,而且对长期成功而言至关重要。

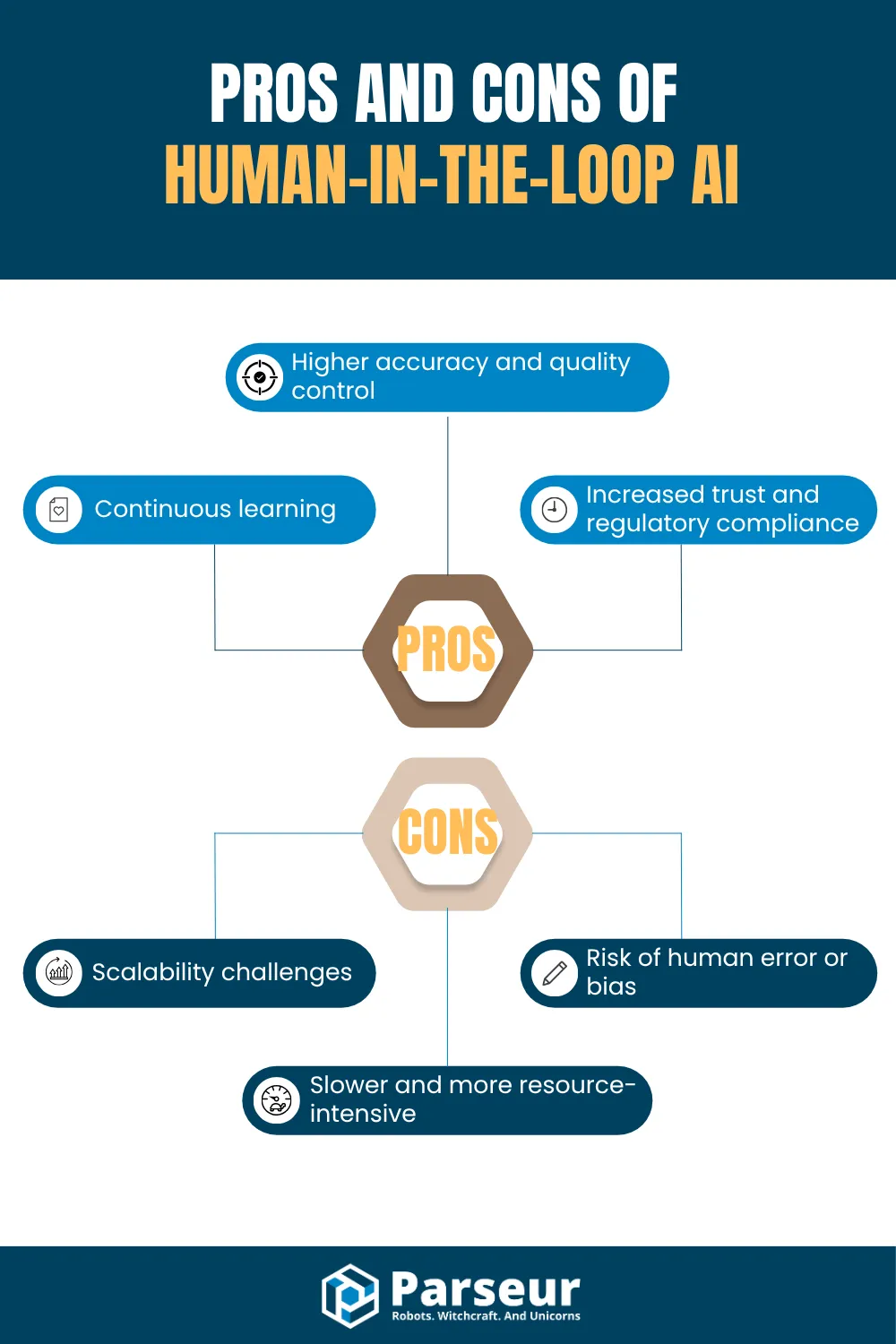

人参与环AI的优缺点

人参与环AI带来了重要的益处,也存在现实的权衡。理解这些,对于企业决策何时人工介入至关重要。

优势:

- 更高的准确率和质量管控:人工能及时发现AI未识别的偏差或复杂情况。

- 增强信任与合规性:人工监督让AI系统更透明,更易获得监管方、利益相关者与客户认可。

- 持续学习:人工反馈帮助AI模型通过更好的再训练和修正闭环持续提升。

劣势:

- 速度更慢、成本更高:人工参与降低自动化速度,并带来用人成本。

- 扩展难度增加:如果规划不周,人工无法轻松扩展至大批量任务。

- 可能有人为失误或偏见:人工虽然能减少AI错误,但也可能带来主观偏见或不一致。

根据2024年麦肯锡的调研,27%的企业在使用生成式AI时会在使用前审核所有输出内容。这表明即使自动化规模化,人工监督也是质量保障的重要组成部分。

何时选择人参与环VS全自动AI

选择人参与环(HITL)还是全自动AI,取决于任务的复杂度、出错后果以及是否需要人工判断或监督。对比如下:

| 对比因素 | 人参与环AI | 全自动AI |

|---|---|---|

| 最佳适用场景 | 需要判断、伦理或合规的高风险决策 | 重复、低风险且变化不大的任务 |

| 举例 | 医疗诊断、金融审批、招聘、法律审核 | 垃圾邮件过滤、图片标注、商品评论归类 |

| 人工角色 | 审核、修正或引导AI输出 | 极少或无人工参与 |

| 出错后果 | 高:可能影响生命、安全、合规或公平 | 低:通常可恢复或影响较小 |

| 灵活性要求 | 高:需要逐案判定 | 低:任务可预测、基于规则 |

| 数据洞察 | 74%的大型美企在招聘决策中应用HITL工具 | 73%的组织计划在2027年前用AI自动化重复性任务 |

关键是找到平衡点:

- 当错误代价高、需伦理判断或数据复杂多变时,建议采用HITL;

- 任务简单、可扩展且小失误可容忍时,适合全自动AI。

结论

HITL AI通过在关键阶段引入人工监督,为AI系统带来更高的准确性、道德性和适应性,尤其适合高风险或动态环境。自动化结合人工判断,HITL提升了决策质量,加强信任、责任和长期绩效。

随着越来越多企业采用AI,如何以及何时引入人工环节变得至关重要。HITL不是阻碍AI进步,而是让AI更聪明、更安全、更贴合现实需求。

想进一步了解如何高效应用HITL、为组织迎接AI变革做好准备,请参考我们的人参与环AI:定义、优势与2026趋势。其中详细介绍了HITL实施策略、未来趋势以及如何将其与业务目标契合。

最后更新于